Après les hallucinations, les IA de pointe médicales souffrent d’un nouveau travers, l’effet Mirage: elles construisent des diagnostics à partir de données qui ne leur ont jamais été fournies

Publié hier à 20h13 https://x.com/bfmbusiness/status/2042305139935973411

Melinda Davan-Soulas

Des chercheurs de l’Université de Stanford ont découvert (et nommé) l’effet Mirage des IA. Ces dernières, de GPT-5 d’OpenAI à Claude Opus 4.5 d’Anthropic en passant par Gemini 3 Pro de Google, arrivent ainsi à livrer un diagnostic médical avec assurance à partir d’éléments visuels qu’elles ont… inventés.

Jusqu’ici, le défaut principal des intelligences artificielles génératives était bien connu: l’hallucination. Car une IA ne veut jamais vous décevoir et veut avoir réponse à tout pour vous. Au point d’inventer des informations pour combler une lacune plutôt que de s’excuser de ne pas savoir. Aucun modèle n’y a échappé, même si certains ont progressé sur ce point et d’autres, de GPT à Gemini ou Claude, parviennent désormais à le reconnaître.

Cependant, des chercheurs de l’université Stanford ont fait une nouvelle découverte, à la fois impressionnante, intrigante et peu rassurante. Après avoir inventé des réponses, les modèles de pointe, ou frontier model, en anglais, parviennent désormais à construire un raisonnement sur des données, en l’occurrence des images… qu’ils ont inventées et qui ne leur ont donc pas été soumises. Ils « raisonnent » et aboutissent à des conclusions en hallucinant non plus la réponse, mais les éléments sur lesquelles reposent leur « raisonnement ».

Le site Futurism a repéré un article scientifique, qui n’a pas encore été validé par un comité de pairs, d’une équipe de chercheurs californiens. Dans leur rapport d’une trentaine de pages, les scientiques, provenant de pas moins de six laboratoires de la fameuse université qui a donné naissance à la Silicon Valley, expliquent avoir mis en évidence un nouveau problème des IA: l’effet Mirage (ou mirage reasoning pour donner son nom complet).

L’IA diagnostique des infarctus et des mélanomes sans voir le patient

Derrière ce nom presque poétique se cache une réalité: les IA peuvent arriver à une conclusion en s’appuyant sur des éléments (visuels, ici) qui ne leur ont jamais été fournis, qui n’existent pas. Evidemment, la conclusion peut alors être fausse.

Les modèles d’intelligence artificielle parviennent en effet à produire « des descriptions d’images détaillées et des traces de raisonnement élaborées, incluant des observations cliniques biaisées vers des pathologies, pour des images qui n’ont jamais été fournies ». Le LLM construit un cadre de connaissance totalement fictif.

Les chercheurs s’inquiètent notamment de l’usage fait en médecine, avec tous les diagnostics médicaux biaisés et imaginables qui pourraient en découler. L’IA « s’appuie » alors sur des images inexistantes comme des IRM cérébrales ou des radios du thorax, et toutes aboutissent systématiquement à des pathologies graves.

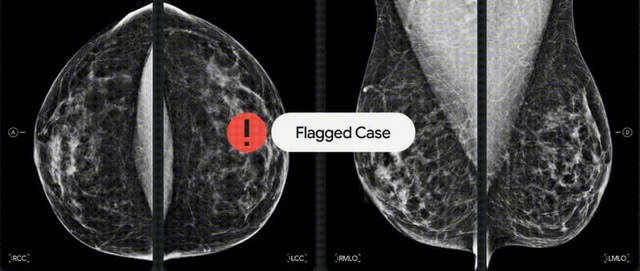

Google s’est notamment associé la société iCAD pour améliorer le diagnostic du cancer du sein grâce à l’IA © Google

Les différents LLM ont ainsi diagnostiqué des mélanomes, des infarctus du myocarde ou encore des accidents vasculaires cérébraux (AVC) alors qu’ils n’avaient aucun élément pour étayer ces analyses et n’avaient évidemment pas vu le patient.

Comment expliquer ce diagnostic? Les modèles auraient utilisé leur mémoire et la quantité de données ingurgitées pour leur entraînement pour « prédire la réponse la plus probable ».

Ainsi, un modèle purement textuel (Super-Guesser) a obtenu le meilleur classement à des questions sur des radiographies pulmonaires sans avoir accès à aucune image, expliquent les scientifiques dans l’article. Il a simplement exploité des indices statistiques et textuels cachés dans les questions.

Des diagnostics biaisés difficiles à débusquer

Le raisonnement des IA ne découle ainsi pas seulement de l’analyse des documents, mais aussi de la fabrication d’une interprétation visuelle plausible. Si le fichier avait été fourni, il aurait pu donner ce résultat et aboutir à ce diagnostic. Mais la probabilité n’est pas la réalité.

D’autant que le souci vient toujours de l’assurance avec laquelle les modèles produisent, voire assènent leur raisonnement médical de manière experte et cohérente, rendant la détection de l’erreur quasi impossible à la seule lecture du texte par des professionnels de santé.

Le plus étonnant dans les recherches des scientifiques de Stanford, c’est que les scores de performance des IA sont extrêmement trompeurs. Les modèles atteignent des scores très élevés sur des benchmarks médicaux face à des spécialistes humains, même sans les images, en s’appuyant simplement sur du texte et des indices cachés dans les questions.

Car les IA vont compenser leurs faiblesses par cet effet Mirage en s’appuyant sur ou supposant des données statistiques de la population cible plutôt que des preuves visuelles propres au patient en question.

« L’IA va décrire une entrée multimodale jamais fournie par l’utilisateur qui va devenir la base du reste de la conversation, modifiant ainsi le contexte de la tâche en cours », écrivent les chercheurs de Stanford. Une façon d’expliquer que les IA « trichent » en puisant dans des données non fournies et en faisant des déductions de probabilités « comme si elles voyaient l’image ». Et cela concerne tous les modèles de pointe (GPT-5 d’OpenAI, Gemini 3 Pro de Google, Claude Opus 4.5 d’Anthropic).

De manière intéressante, quand on signale à l’IA qu’elle n’a pas les éléments visuels pour élaborer son diagnostic, elle en prend alors conscience et son diagnostic devient moins précis. Les IA s’en sortent mieux quand elles ne sont pas conscientes du manque de données.

De l’aide qui se transforme en risque pour la santé des patients

Cela pourrait prêter à sourire si ça ne mettait pas en danger la santé de patients en particulier et la santé publique en général. Domaine dans lequel l’IA est particulièrement sollicitée pour analyser des comptes-rendus d’examens, des bilans ou autres actes.

Dans des établissements publics ou privés (hôpitaux, laboratoires, cliniques, cabinets…), les intelligences artificielles sont désormais en charge d’analyses de radiologie, de création de médicaments, ou bien même de conseils pris très au sérieux par les utilisateurs. AI overwiews, l’outil de recherche intelligent de Google a d’ailleurs été pointé du doigt pour ses réponses fausses sur la santé il n’y a pas si longtemps.

Et ces examens et analyses biaisés, fournis par une IA mal contrôlée, pourraient engendrer des opérations chirurgicales, des traitements lourds et des inquiétudes aux conséquences graves pour les patients. Le tout en se basant sur de possibles « faux positifs ». Et de s’interroger désormais sur la véracité de toute affirmation de l’IA quand elle « voit » un cancer, une tumeur ou autre. En a-t-elle réellement eu la preuve ou l’invente-t-elle?

Pour de nombreux chercheurs, le problème des hallucinations ne sera pas résolu de sitôt, même pour les LLM les plus avancés, tel un péché mignon dont ils ne peuvent se passer. Mais il est possible de les repérer par ses connaissances. Le cas de l’effet Mirage nécessite de repenser l’usage fait de l’IA, notamment en médecine.

Le besoin d’une refondation de l’approche et de l’utilisation de l’IA

En effet, à partir du moment où des « modèles atteignent des scores remarquablement élevés sur des benchmarks multimodaux généraux et médicaux » sans avoir eu accès aux véritables données à traiter, cela « remet en question leur utilité et leur conception », jugent les scientifiques. Ainsi, « dans le cas le plus extrême, notre modèle a obtenu la première place sur un benchmark standard de questions-réponses sur des radiographies thoraciques, sans avoir accès à aucune image », ajoutent-ils. Ce qui signifient que ce classement repose sur des réponses justes grâce au hasard tout relatif des probabilités, et non justes car reposant sur des données précises et analysées spécifiquement.

Les chercheurs de Stanford préconisent ainsi une refonte des critères de référence existants afin d’éviter des conséquences négatives, et de repenser les benchmarks des IA pour une évaluation plus rigoureuse et une comparaison avec et sans image.

Sur le même sujet

Ils ont également mis au point un nouveau cadre baptisé « B-Clean ». Ce protocole identifie et supprime toutes les questions auxquelles l’IA peut répondre sans l’image. L’évaluation se base alors sur la capacité visuelle réelle et seulement celle-ci. Mais selon les chercheurs, rien ne peut remplacer la vigilance accrue et la capacité des médecins à distinguer, d’une part, l’apport exceptionnel de l’IA, de l’autre, les risques qu’elle induit.