Le 12 novembre 2025, la Commission européenne a présenté son plan « pour un bouclier de la démocratie ». Mais un bouclier contre qui et pour défendre quelle « démocratie » ? La genèse de ce « bouclier » révèle une filiation directe avec l’écosystème de censure américain mis en place après l’élection de Donald Trump pour « protéger » les électeurs d’analyses jugées problématiques. Paniqués par le phénomène des fake news, nos dirigeants et représentants sont désormais prêts à abolir la liberté d’expression en ligne.

publié le 14/01/2026 https://elucid.media/politique/bouclier-europeen-de-la-democratie-le-plan-de-bruxelles-pour-eduquer-les-electeurs

Par Camille Adam

Avant d’être concrétisée par un ensemble de mesures, le bouclier européen de la démocratie est d’abord une doctrine. Cette doctrine consiste premièrement à présenter les élections comme des infrastructures critiques d’un pays ou d’un espace, qu’il conviendrait de protéger au même titre que les infrastructures de télécommunications, énergétiques, etc. Deuxièmement, il s’agit de garantir l’intégrité de « l’espace informationnel », c’est-à-dire du débat public, qui précisément se tient en amont de l’élection. Un nouveau paradigme voit ainsi le jour. Désormais, les élections ne sont plus menacées uniquement par la fraude électorale, mais aussi par la fraude informationnelle.

Un « centre européen pour la résilience démocratique »

Mais alors en quoi consiste ce bouclier de la démocratie ? Essayons d’aller à l’essentiel tant les annonces sont nombreuses, en particulier dans des domaines où la Commission n’a pas de compétence.

La mesure la plus concrète annoncée est la création d’un Centre européen pour la résilience démocratique. Ce Centre servirait d’interface entre la Commission et la société civile organisée (ONG), les universités, les think tanks, ainsi que la communauté des fact-checkeurs. Ces derniers seraient regroupés au sein d’un nouveau réseau européen des fact-checkeurs soutenu par la Commission, en complément de l’Observatoire européen des médias numériques déjà existant. L’adhésion à ce Centre resterait volontaire.

Mais qu’est-ce que la « résilience démocratique » qui devrait être assurée et protégée par ce « Centre » et ces parties prenantes ? Pour faire simple, la résilience démocratique renvoie principalement à la lutte contre la désinformation et la capacité pour la société d’encaisser cette désinformation. Et cette lutte se veut tous azimuts : au niveau des communes, des médias, des ONG, à l’école par l’éducation aux médias et au numérique…

Le Digital Services Act – réguler les contenus pour réguler les comportements

Mais le cœur du réacteur de cette lutte contre la désinformation, c’est évidemment la censure dont l’outil principal est le DSA (ou Digital Services Act), le règlement européen élaboré et adopté sous l’égide de Thierry Breton alors commissaire européen. Ce règlement européen (une loi européenne) régit les relations entre les plateformes et réseaux sociaux (TikTok, YouTube, Facebook, X, etc.) et les autorités européennes et nationales (ex. : Commission européenne, Arcom).

Le texte part du constat que les réseaux sociaux peuvent être le véhicule de contenus problématiques conduisant à la promotion et diffusion de comportements destructeurs : cyberharcèlement, dérives sectaires et religieuses, promotion de régimes alimentaires dangereux pour la santé, promotion de discours racistes, masculinistes et bien sûr diffusion de fausses informations et de théories du complot.

Il est absolument indéniable que les réseaux sociaux posent un très grand nombre de problèmes sociétaux qui ne peuvent être minimisés, en particulier pour les publics les plus vulnérables, c’est-à-dire les mineurs. Le principe de la régulation de telles plateformes ou réseaux est donc légitime.

Une révolution juridique – censurer les contenus légaux

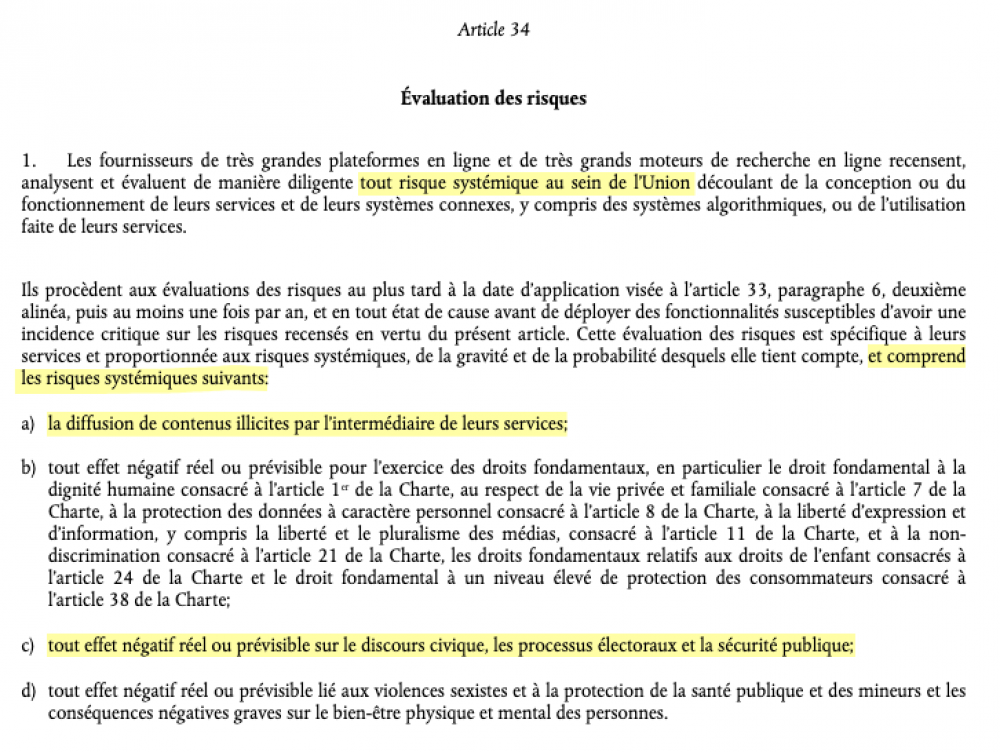

La mécanique choisie pour appréhender ces dangers est de mélanger ces derniers sous la catégorie englobante de « risques systémiques » que les plateformes sont tenues d’identifier et « d’atténuer ». Cette atténuation peut et doit se faire selon le texte notamment par la « modération » qui est définie comme l’ensemble des « mesures prises qui ont une incidence sur la disponibilité, la visibilité et l’accessibilité de ces contenus ou ces informations, telles que leur rétrogradation, leur démonétisation, le fait de rendre l’accès à ceux-ci impossible ou leur retrait, ou qui ont une incidence sur la capacité des destinataires du service à fournir ces informations, telles que la suppression ou la suspension du compte d’un destinataire ».

Le problème est que la catégorie de risques systémiques est extrêmement large. Le règlement donne des exemples :

- la diffusion de contenus illicites par l’intermédiaire de leurs services ;

- tout effet négatif réel ou prévisible sur le discours civique, les processus électoraux et la sécurité publique ; ou encore

- tout effet négatif réel ou prévisible lié aux violences sexistes et à la protection de la santé publique et des mineurs et les conséquences négatives graves sur le bien-être physique et mental des personnes.

Le DSA ouvre ainsi la voie à la modération de contenus parfaitement légaux, dès lors qu’ils sont considérés comme pouvant troubler le débat démocratique, les processus électoraux ou l’ordre public.

Les choses deviennent donc très étranges, il faudrait modérer des contenus qui ne violent aucune loi parce que leur effet serait de porter atteinte au discours civique, aux élections et à la sécurité publique.

On ne pouvait pas faire une catégorie plus large et plus dangereuse pour la liberté d’expression. Ce flou est-il le fruit d’une erreur ou maladresse de rédaction ou bien d’un choix délibéré ? La genèse du DSA et du « bouclier de la démocratie » nous donne la réponse.

La genèse (américaine) du DSA et du bouclier de la démocratie

Le DSA et le bouclier démocratique ne sortent pas de nulle part, ils sont la tentative de répliquer un système mis en place aux États-Unis entre 2016 et 2022.

En 2016, l’élection de Donald Trump constitue un traumatisme pour une grande partie de l’élite américaine et en particulier de la haute administration. L’élection a été marquée par l’apparition du phénomène des fausses nouvelles et plus tard en 2018 par le scandale « Cambridge Analytica », nom de la société britannique qui a exploité illégalement les données personnelles de millions d’utilisateurs Facebook pour tenter d’influencer des élections américaines de 2016 (dans le sens de Donald Trump).

Une croyance se fait jour au sein de l’establishment américain, l’élection a été gagnée grâce à la désinformation (venant potentiellement de l’étranger) et au ciblage de la publicité politique. Conclusion : il fallait créer un système et des outils pour contrôler le débat public sur les réseaux sociaux, limiter les interférences et garantir son intégrité.

On commence alors à parler de guerre cognitive, de sécurité cognitive, à présenter l’opinion publique comme un champ de bataille et à présenter le cerveau humain comme un « terrain » opérationnel. Mais surtout, une nouvelle notion voit le jour : la résilience démocratique. Cette résilience sera assurée principalement par deux vecteurs : la lutte contre la désinformation et l’éducation aux médias. Pour réaliser cette mission, tout un écosystème va se constituer. Il s’agit d’impliquer « tout le monde », c’est la « whole-of-society approach ».

La privatisation de la censure aux États-Unis – le système CISA

Selon un rapport du Congrès américain de 2023, le système mis en place était le suivant : la CISA (Cybersecurity and Infrastructure Security Agency) recevait des signalements de contenus « problématiques », les transmettait aux plateformes (Twitter/X, Facebook, Google, etc.), en sachant pertinemment que cela déclencherait des mesures de modération. Même si la CISA prétendait ne pas « ordonner » de suppressions, le rapport soutient que l’effet était prévisible, systématique et recherché. Face aux risques juridiques, la CISA aurait transféré ses activités vers des ONG qu’elle finance elle-même, notamment CIS / EI-ISAC (Center for Internet Security), Election Integrity Partnership, Virality Project. L’objectif assumé dans des e-mails internes : « éviter l’apparence de propagande gouvernementale ».

Les « Twitter Files » – révélations sur les pratiques de censure politique du réseau social

Le contenu de ce rapport du Congrès américain concorde avec les révélations des Twitter Files faites à peu près à la même période entre décembre 2022 et janvier 2023 lors du rachat de Twitter par Elon Musk. Les documents internes de Twitter (désormais appelé X) révèlent ainsi l’existence de mécanismes permettant qu’un contenu reste en ligne sans violer les règles, tout en étant invisible dans les recherches, exclu des tendances peu ou pas recommandé. Ces décisions étaient souvent manuelles, pas seulement algorithmiques.

Les comptes les plus visés étaient les comptes conservateurs, libertariens ou critiques des politiques sanitaires ou encore parfois des comptes de gauche anti-OTAN ou anti-impérialistes. Le critère dominant n’était pas uniquement la désinformation factuelle, mais le plus souvent le risque politique, le contexte médiatique ou la pression institutionnelle.

Les Twitter Files documentent des échanges réguliers avec le FBI (via sa Foreign Influence Task Force), le Department of Homeland Security (DHS) et parfois le Pentagone. Ces agences signalaient des comptes, demandaient des suppressions ou des restrictions, transmettaient des listes de contenus à examiner. Et même si Twitter n’obéissait pas toujours, le canal institutionnel était routinisé, structuré et permanent.

Le DSA : une réplique du système CISA

Le projet de DSA sera officiellement présenté à la Commission le 15 décembre 2020, en pleine année Covid où la « modération » des contenus critiques des politiques sanitaires, les théories sur l’origine du virus et sur la sécurité des futurs vaccins battent leur plein. Les plateformes sous système CISA font alors déjà le travail, mais dans un contexte de montée de l’extrême droite en Europe et de ce qui est perçu comme un complotisme sanitaire, l’Europe veut institutionnaliser elle aussi ses relations avec ces plateformes et mettre en place son propre écosystème. À l’époque tout va pour le mieux, car les vues en matière de lutte contre la désinformation sont parfaitement alignées des deux côtés de l’Atlantique.

Le texte met ainsi en place un « embryon » d’écosystème de surveillance des contenus problématiques en vue de leur modération avec d’une part les signaleurs de confiance (des experts de la détection et notification de contenus illicites) et d’autre part les autorités nationales et européennes. Mais est-ce que cela suffit à faire une filiation entre les deux systèmes DSA et CISA ?

Environ deux semaines plus tôt, le 3 décembre 2020, la Commission venait de présenter son plan d’action pour la démocratie dans le cadre d’une communication. On y retrouve absolument toute la rhétorique de la résilience démocratique développée aux États-Unis par les think tanks (en particulier la RAND Corporation et le German Marshall Fund), les universités et le gouvernement fédéral. On ne parle pas encore de « whole of society approach » qui viendra avec l’annonce du bouclier démocratique. L’ingérence étrangère est mentionnée, mais pas encore au cœur de la rhétorique actuelle.

La filiation entre le DSA et le système CISA est totale. On pourra d’ailleurs s’amuser à découvrir sur Google Trends, un outil de Google qui permet de retracer l’historique des mots ou expressions les plus recherchés, que la première occurrence de l’expression « bouclier démocratique » (en français) dans les recherches Google se trouve… aux États-Unis… dans la région de Washington… en mai 2021. D’ailleurs, lors de la consultation de la Commission sur le projet de bouclier européen, l’une des contributions viendra d’un think tank… américain, le German Marshall Fund qui avait déjà été impliqué sur ces questions aux États-Unis.

C’est donc au regard de cette filiation qu’il faut comprendre la notion de « risque systémique ». Compte tenu du modèle américain, on comprend que l’idée est de laisser le plus de marge aux plateformes, mais aussi au régulateur pour « modérer » les contenus problématiques. Et comme dans le CISA, la censure de contenus légaux (mais « problématiques ») par un régulateur public n’est pas assumée.

Les injonctions de retrait ne visent que les contenus illicites pas ceux qui ont un effet négatif sur le discours civique, les élections ou la sécurité. C’est aux plateformes d’apprécier ce qui doit être modéré. Toutefois il est bien précisé que les mesures de modération sont revues par la Commission qui si elle les juge insatisfaisantes peut inviter la plateforme à en prendre des nouvelles. Elle ne peut cependant la forcer. Comme aux États-Unis, il s’agit de sauver les apparences et dans le flou réglementaire, les plateformes seront incitées à faire du surblocking (le surblocage), c’est-à-dire filtrer plus de contenus que nécessaire pour éviter tout risque juridique. La censure de contenus licites mais sous-traitée au secteur privé venait d’être introduite dans notre droit.

Un changement de paradigme imprévu : le retour du free speech aux États-Unis

Le DSA est finalement adopté le 19 octobre 2022 avec une entrée en vigueur pour le 17 octobre 2024. Rien ne pressait, Joe Biden était encore président des États-Unis, Facebook avait purement et simplement fait disparaître quasiment tout le contenu politique de la plateforme, Twitter menait sa politique de modération en lien avec les autorités américaines qui sera révélée plus tard, TikTok est déjà bien actif, mais n’est pas encore perçu comme une menace dans le champ de l’information et des élections et YouTube applique une politique commerciale de respectabilité compte tenu du poids des annonceurs dans son business model. En d’autres termes, même avec un DSA non entré en vigueur, l’information était relativement sous contrôle dans le champ des réseaux sociaux et des plateformes.

Le DSA ne posait alors pas de gros problème aux plateformes puisque le règlement leur imposait des règles auxquelles elle jouait déjà avec le gouvernement américain.

Mais tout change au début de 2023, plusieurs mois après le rachat de Twitter par Elon Musk (Twitter deviendra « X »). La nouvelle direction supprime quasiment toute modération sur le réseau social, inaugurant une ère de laissez-dire total. Les premières confrontations avec l’Europe et notamment des échanges musclés entre Elon Musk et Thierry Breton ont lieu. Le message de Thierry Breton est clair, X sera mis au pas par le DSA et remettra en place au moins en Europe toutes ses politiques de modération des contenus. La situation se tend, rien n’évolue jusqu’à l’élection de Donald Trump fin 2024. Entre-temps, la donne a changé par rapport à 2016. Les « seigneurs de la Tech » — Mark Zuckerberg, Jeff Bezos, Tim Cook, Sundar Pichai — ont prêté allégeance à Donald Trump. Ils annoncent un revirement au moins partiel de certaines politiques de modération, à commencer par l’arrêt de toute collaboration avec les fact-checkeurs.

With great audience comes greater responsibility #DSA

As there is a risk of amplification of potentially harmful content in 🇪🇺 in connection with events with major audience around the world, I sent this letter to @elonmusk

📧⤵️ pic.twitter.com/P1IgxdPLzn

— Thierry Breton (@ThierryBreton) August 12, 2024

Dans le cadre de ses négociations commerciales avec l’Union européenne, Trump exige la suppression du DSA ou du moins l’exemption des plateformes américaines de s’y soumettre. Mais pour le moment, celui-ci est en vigueur et les plateformes sont tenues de s’y conformer. Qu’en est-il ?

Ce qui semble ressortir à ce stade, c’est que les plateformes ont fait le choix de la conformité minimum ou de façade avec le DSA. En d’autres termes, elles traînent des pieds. Les rapports de transparence sont incohérents, les données pour les chercheurs sont peu exploitables, Facebook et Instagram ne sont pas en conformité avec les règles de protection des mineurs et X n’est conforme à quasiment rien et vient d’être condamné à 120 millions d’euros de pénalité à ce titre. Une dizaine de procédures sont ouvertes contre la plupart des plateformes, à l’exception de YouTube.

Quel avenir pour la censure politique en Europe ?

Quand on parle de contenu politique, on pense à Facebook, YouTube, X et TikTok. Facebook a, on l’a vu, retiré tout son contenu politique entre 2020 et 2021, le fait qu’ils aient cessé toute collaboration avec les fact-checkeurs n’a donc en pratique rien changé. On peut considérer que Facebook ne jouera plus de rôle d’envergure en matière de diffusion d’informations.

YouTube tolère le contenu politique, mais adopte une politique de modération très violente sur tous les types de contenus, non pas pour se mettre en conformité avec le DSA, mais en raison de son business model comme nous l’avons vu. Les annonceurs n’aiment pas être associés à du contenu trop politique. YouTube ne veut pas pour son image de marque être perçu comme une plateforme populiste.

Une question importante et notamment pour l’avenir d’Élucid, mais plus largement de tous les médias indépendants hébergés sur YouTube : dans quelle mesure YouTube va-t-il collaborer avec les autorités européennes et nationales et dans quelle mesure collabore-t-il déjà ? La surcouche de censure européenne va-t-elle se rajouter à la censure pour des raisons commerciales ?

Des auditions d’un représentant de YouTube France à l’Assemblée nationale le laissent penser. En effet, celui-ci révéla que YouTube invisibilisait des contenus légaux et même conformes à leurs conditions générales d’utilisation, et en l’occurrence des contenus politiques. Cela correspond en tout point à la « modération » des contenus « posant un risque systémique » commandée par le DSA. YouTube semble donc beaucoup plus disposé à collaborer et être acteur de ce régime CISA européanisé.

Le caractère sournois de cette censure est qu’en plus d’avoir été sous-traitée au privé pour sauver les apparences de la « démocratie européenne », elle est opaque et difficile à prouver. On ne peut que se reposer sur un faisceau d’indices : baisse soudaine des vues de manière pérenne (donc non liée à un événement particulier) du jour au lendemain, abonnés qui se plaignent de ne plus voir les vidéos de la chaîne recommandées… et contrairement à avant les contenus jugés problématiques ne sont pas purement et simplement supprimés, ils ne sont plus recommandés ce qui revient concrètement à les faire disparaître de fait.

Concernant X, nous l’avons vu, le mot d’ordre reste pour l’heure le principe de liberté d’expression totale malgré les sanctions américaines.

Reste TikTok, le réseau social chinois qui réunit 21 millions d’utilisateurs en France. La plateforme est surveillée de près par les autorités, notamment depuis l’affaire de l’élection roumaine. En décembre 2024, la Cour constitutionnelle de Roumanie a annuléles résultats du premier tour de l’élection présidentielle après que Călin Georgescu, un candidat d’extrême droite jusqu’alors marginal, ait obtenu 23 % des voix et qu’il se soit retrouvé en tête, très au-dessus des prévisions des sondages. Cet exploit électoral a été attribué en grande partie à une forte viralité de sa campagne sur TikTok, où son contenu a explosé en visibilité, notamment auprès des jeunes, ce qui a suscité des soupçons de manipulation numérique et d’ingérence extérieure.

Ce scénario terrorise les élites européennes et françaises. TikTok serait capable dans leur esprit de faire gagner n’importe quel candidat présent sur la plateforme qui produirait un contenu viral. Depuis cette affaire, l’idée que les réseaux sociaux pourraient altérer la sincérité du scrutin est dans toutes les têtes de nos représentants et dirigeants. Ce récit commode omet de nombreux éléments : les sondages roumains sont peu fiables, avec des taux de non-réponse élevés ; ils captent mal les électorats protestataires, abstentionnistes ou jeunes ; Georgescu n’était pas inconnu politiquement. De plus, les sondages n’ont pas montré le vote sanction massif qui se préparait. Les Roumains, comme beaucoup de peuples européens, rejettent de plus en plus les candidats pro-UE assimilés à des pions du système.

Le candidat Georgescu a donc pu surfer sur ce mécontentement et offrir un débouché populaire à cette colère préexistante. TikTok lui a permis effectivement de contourner le verrou des médias traditionnels dans lesquels il n’était pas invité. TikTok n’a pas créé le rejet des élites roumaines, il a permis de l’exprimer autrement que par de l’abstention.

En outre, il n’a jamais été démontré combien de comptes étaient faux, combien de vues étaient frauduleuses, et encore moins combien de votes avaient réellement été « altérés ».

Le précédent créé est donc terrible ; une élection a été annulée sur la base d’un risque informationnel. Une procédure a été ouverte contre TikTok le 17 décembre 2024 pour non-conformité de l’obligation d’atténuation des risques systémiques lors de processus électoraux. Il est difficile à ce stade de savoir comment la plateforme va se positionner : liberté d’expression en matière de contenu politique ou collaboration avec les autorités européennes et donc censure. Seul l’avenir nous le dira.

Suspendre les réseaux, annuler les élections, sanctionner les désinformateurs : les scénarios à l’étude

Pris en étau entre les politiques commerciales de respectabilité des plateformes et la volonté assumée de l’Union européenne de contrôler le discours, l’avenir des médias indépendants et créateurs de contenus politiques est très incertain.

Nous pouvons anticiper que si l’UE n’arrive pas à obtenir le degré de modération souhaitée de la part de X ou TikTok, des mesures beaucoup plus lourdes seront envisagées. La rapporteure Lætitia Saint-Paul (Horizon et Indépendant) dans un rapport sur l’irruption de l’IA dans les ingérences étrangères, a proposé la suspension des réseaux sociaux un mois avant des élections.

L’autre hypothèse que nous pressentions et qui s’est réalisée au moment de l’écriture de ces lignes était que les autorités fassent des exemples marquants et traumatisants en sanctionnant très lourdement des personnes ayant véhiculé des narratifs jugés problématiques.

Ainsi le 15 décembre 2025, Xavier Moreau (ancien officier français et consultant basé en Russie) et Jacques Baud (ancien colonel de l’armée suisse et analyste stratégique) ont fait l’objet de sanctions jusqu’alors réservées aux terroristes de Daesh et d’Al-Qaeda, à savoir le gel de leurs avoirs et l’interdiction de rentrer en France au motif que leurs analyses constituent des relais de la propagande du Kremlin. On peut anticiper que la violence de ces sanctions, dont la légalité est par ailleurs douteuse, va inciter à la modération (donc à l’autocensure) un certain nombre de voix critiques des positions bellicistes des autorités européennes.

Terroriser plutôt que censurer. En psychologie sociale, l’on parle de « chilling effect » (l’effet de refroidissement), un phénomène déjà observé chez les créateurs de contenus sur YouTube qui renoncent à certaines analyses ou certains propos du fait de la peur de voir leur vidéo invisibilisée.

La dernière hypothèse serait évidemment l’annulation d’élections au nom d’une supposée altération de la sincérité du scrutin.

Avec le bouclier européen pour la démocratie, l’Union européenne poursuit sa trajectoire logique. Faute d’obtenir le consentement des populations à son projet, elle s’attache à contenir et à rendre invisibles les contestations. Ce faisant, elle entre dans une nouvelle ère, après avoir fait prévaloir les libertés économiques sur les droits sociaux, l’Union européenne s’en prend désormais aux libertés politiques fondamentales et, en premier lieu, la liberté d’expression.

Photo d’ouverture : Conclusions de la réunion hebdomadaire de la Commission von der Leyen d’Henna Virkkunen, vice-présidente exécutive de la Commission européenne, et Michael McGrath, commissaire européen, sur le bouclier européen de la démocratie et la stratégie de l’UE pour la société civile, Bruxelles, 12 novembre 2025 (Photo : Aurore Martignoni – CE – Service audiovisuel)