Ce que les médecins pensent de l’IA

Frédéric Haroche | 04 Octobre 2024 https://www.jim.fr/viewarticle/que-médecins-pensent-lia-2024a1000i6r?uac=368069PV&ecd=wnl_all_241004_jim_jim-plus_&sso=true

Ce que les médecins pensent de l’IA

Paris – Depuis 2022, l’intelligence artificielle bouleverse des secteurs entiers de l’économie et de la médecine. Principalement matérialisée par les IA génératives telles que ChatGPT, elle suscite autant d’enthousiasme que d’inquiétude. Dans ce contexte de révolution, notre partenaire Medscape a sondé le corps médical sur son rapport avec la machine. Cette étude s’est basée sur une enquête auprès de 1 077 médecins français interrogés par mail.

Libérer du temps médical… sans toucher au jugement clinique

À l’instar de la population générale, 36 % des médecins expriment des appréhensions face au développement de l’IA, tandis que 20 % restent neutres sur la question et 44 % manifestent leur enthousiasme. Cette inquiétude pourrait être corrélée à un certain manque d’information, puisque 50 % des médecins s’estiment mal informés sur le sujet. Les praticiens inquiets craignent notamment que l’IA se substitue au jugement clinique, avec 39 % se déclarant assez ou très inquiets à ce sujet (auxquels on pourrait ajouter 42 % de « peu inquiets »).

Quoi qu’il en soit, l’IA demeure un outil théorique pour la majorité des médecins. Seuls 20 % l’ont utilisée « pour faire des recherches sur des pathologies », 11 % comme aide au diagnostic et 6 % pour prédire un diagnostic. Pour le reste, l’IA semble, pour le moment, se cantonner à des tâches administratives. Néanmoins, les médecins entrevoient les grandes potentialités de ces nouveaux outils, 57 % se déclarant prêts à les utiliser pour les diagnostics.

L’IA est également perçue comme un futur « libérateur » de temps médical. Par exemple, 67 % envisagent de l’utiliser à l’avenir pour les tâches administratives et 61 % pensent qu’elle libérera les médecins de ces corvées.

De « je l’ai lu sur Doctissimo » à « c’est ChatGPT qui l’a dit »

Concernant les erreurs médicales, 22 % des sondés estiment que l’IA risque de les augmenter en raison de la trop grande confiance accordée à ces logiciels, mais 54 % pensent qu’elle les diminuera. Inquiets ou non, 86 % des praticiens souhaitent que l’État et les sociétés savantes fassent preuve d’une grande vigilance quant au déploiement de l’IA en médecine.

Étonnamment, les patients semblent assez éloignés de ces préoccupations, et seuls 9 % des médecins déclarent avoir reçu des questions à ce propos de la part de leurs malades. Pourtant, 77 % des médecins interrogés s’inquiètent de l’auto-diagnostic via l’IA, qui pourrait, à l’instar d’Internet autrefois, bouleverser la relation entre le médecin et le patient.

Le rapport complet:

L’IA en médecine ne doit pas échapper… aux médecins !

https://www.larevuedupraticien.fr/article/lia-en-medecine-ne-doit-pas-echapper-aux-medecins-0

Fil d’Ariane

- Actualités

- L’actu

- L’IA en médecine ne doit pas échapper… aux médecins !

L’intelligence artificielle (IA) s’avère un outil transformateur dans le domaine médical. Malgré ses promesses, elle soulève des défis éthiques, techniques et cliniques et la question de la formation des médecins…. Le Pr Jean-Emmanuel Bibault, chercheur et radiothérapeute, nous a éclairés sur tous ces enjeux lors de la plénière d’ouverture des Journées nationales de médecine générale (JNMG).

Déjà largement utilisée pour diagnostiquer, aider aux traitements ou prédire des maladies, découvrir de nouvelles molécules ou de nouvelles indications, l’IA promet un séduisant adoucissement des tâches les plus complexes, pénibles ou répétitives. Mais elle amène également de nombreuses questions éthiques et pratiques : confidentialité des données de santé, responsabilité des décisions prises, potentielle aggravation des inégalités d’accès aux soins, formations médicales initiale et continue à adapter, redistribution des tâches, capacité à comprendre comment les modèles d’IA prennent des décisions et donc à vérifier ces dernières (explicabilité), fiabilité des algorithmes nourris de données parcellaires ou normées… Et, nous offrant la possibilité d’alléger notre quotidien, n’ampute-t-elle pas, par là même, notre réflexion et notre indépendance, dans un cercle vicieux ?

Les médecins ont une responsabilité dans le développement de ces nouvelles technologies, concernant leurs applications en santé et, plus largement, leur impact sociétal ; déléguer cette mission à des entrepreneurs qui n’entendent rien au serment d’Hippocrate – et n’ont nullement pour objectif le « vivre plus longtemps en meilleure santé » – pourrait en effet être lourd de conséquences. Les enjeux de profits ne devraient pas orienter l’essor de ces techniques innovantes ; l’objectif devrait être l’amélioration des soins et des conditions de travail des professionnels. Et les tutelles ont un rôle fondamental à jouer dans le financement des projets en développement et dans la validation de l’utilisation de ces nouveaux outils, en vue d’un remboursement et d’une cotation des actes réalisés par leur biais. Chantier colossal dans lequel la vigilance devra rester constante tant le risque est grand d’utiliser l’opportunité offerte pour un écrémage du personnel qualifié…

Il est bien du devoir de la rédaction de La Revue du Praticien d’informer sur le formidable développement de ces techniques, mais aussi de mettre en garde. Tel est l’objet de la session plénière d’ouverture de notre congrès annuel : apporter un regard expert, objectif, optimiste mais vigile sur l’avenir de la médecine et le devenir des médecins, à l’heure où l’IA prend une place croissante.

Il nous revient par ailleurs de continuer à veiller à la qualité des textes publiés dans nos revues, et à leur intégrité manuscrite (ou compuscrite !), sans utilisation d’outils automatisés. Nous avons ainsi ajouté des conditions aux recommandations à nos auteurs, déconseillant l’usage de contenu créé par l’IA, les modèles de langage, l’apprentissage automatique ou toute autre technologie similaire.

Il s’agit bien de continuer à proposer des articles de formation de qualité, dictés par l’expérience clinique et scientifique validée ainsi que par celle de la relation médecin-patient.

La médecine est un art. Et si l’art robotique existe, on est en droit de douter de sa composante émotionnelle. Lorsqu’il s’agit de prendre une décision, en tant que praticien, l’algorithme est un support, mais la part individuelle est si prégnante et si complexe que l’on peine à imaginer qu’elle puisse s’affranchir un jour de l’humain.

POUR EN SAVOIR PLUS

Bibault JE. [Replay] Plénière – Intelligence artificielle en médecine, enjeux de pratique, enjeux éthiques. JNMG 12 octobre 2023.

Bibault JE. Intelligence artificielle et médecine. Rev Prat Med Gen 2023;37(1080);387-90.

Bibault JE. Intelligence artificielle et médecine : la révolution a déjà commencé. Rev Prat 2023;73(7);699.

Publication d’un rapport « Intelligence artificielle et santé mentale – Définir les frontières entre innovation, science et éthique » (Document)

Imprimer la listeRecherche

10/10/2024

Émis par : Collectif MentalTech, Stane Groupe

A l’occasion de la journée mondiale de la santé mentale, le 10 octobre, alors que la santé mentale, et particulièrement celle des jeunes adultes, connaît une dégradation alarmante depuis plusieurs années, le Collectif MentalTech, via un groupe de travail coordonné par Alexia Adda, co-fondatrice de la société KLAVA Innovation, et en collaboration avec Stane Groupe, publie un rapport intitulé « Intelligence artificielle et santé mentale – Définir les frontières entre innovation, science et éthique ».

Le Rapport: https://toute-la.veille-acteurs-sante.fr/files/2024/10/RapportIA_SanteMentale_MentalTech-10.10.2024.pdf

La Conclusion: L’intégration de l’IA dans le domaine de la santé marque le début d’une nouvelle ère, où la médecine se transforme profondément pour devenir plus prédictive, personnalisée, préventive et participative. À l’horizon 2030, nous pouvons

envisager un écosystème de santé où l’IA jouera un rôle central, non seulement

dans le diagnostic et le traitement, mais aussi dans la prévention et la gestion

proactive de la santé.

L’étude menée par le collectif MentalTech apporte un éclairage crucial sur les

opportunités et les défis liés à l’intégration de l’IA dans le domaine de la santé

mentale, en examinant de près les différents cas d’usage, de la détection précoce

des troubles à la formation des thérapeutes. Notre analyse a permis d’identifier

les risques potentiels et de proposer des recommandations concrètes pour

les atténuer. Ce travail s’inscrit bien sûr dans une démarche plus large visant à

construire un écosystème de santé numérique robuste et digne de confiance,

où l’innovation technologique s’allie à une réflexion éthique approfondie pour

améliorer concrètement la prise en charge et le bien-être des patients.

Les algorithmes d’apprentissage profond, nourris par des données massives issues

de diverses sources – dossiers médicaux électroniques, dispositifs connectés,

séquençage génomique – permettront d’identifier des schémas subtils et de

prédire les risques de maladies bien avant l’apparition des symptômes. Cette

capacité prédictive transformera radicalement notre approche de la santé

publique, passant d’un modèle réactif à un modèle proactif.

Parallèlement, l’IA facilitera une médecine véritablement personnalisée. Les

traitements seront adaptés non seulement au profil génétique de chaque patient,

mais aussi à son environnement, son mode de vie et son historique médical

complet. Les assistants virtuels basés sur l’IA deviendront des compagnons de

santé quotidiens, guidant les individus vers des choix de vie plus sains et facilitant

une gestion continue de leur bien-être.

Cette révolution technologique en marche soulèvera par ailleurs de nouveaux

défis éthiques et sociétaux. La Société devra gérer des questions complexes sur

la propriété et la confidentialité des données de santé, l’équité dans l’accès aux soins augmentés par l’IA, et le rôle évolutif des professionnels de santé. Il sera

crucial de maintenir un équilibre entre l’innovation technologique et les valeurs

humaines fondamentales de compassion et d’empathie dans les soins.

En définitive, l’avenir de la santé augmentée par l’IA promet des avancées

extraordinaires, mais exigera une vigilance constante et une collaboration

étroite entre technologues, professionnels de santé, éthiciens et décideurs

politiques. C’est en relevant ces défis collectivement que nous pourrons réaliser

pleinement le potentiel transformateur de l’IA pour améliorer la santé et le bien-

être de l’humanité.

« L’intelligence artificielle s’impose dans les labos de recherche et en santé »

Date de publication : 9 octobre 2024 https://www.mediscoop.net/index.php?pageID=761475770553ba14a0bff23efc4b0eca&id_newsletter=20863&liste=0&site_origine=revue_mediscoop&nuid=44baf5968540a6248a8065e80f2f7273&midn=20863&from=newsletter

Le Figaro observe que « l’intelligence artificielle s’impose partout, générant autant d’inquiétudes qu’elle révolutionne notre quotidien ».

Le journal indique que « loin des polémiques, la recherche scientifique est un domaine où elle fait, jour après jour, la preuve de sa formidable capacité à venir en aide au cerveau humain : archéologie, astronomie, médecine, art, météo… Dans tous ces secteurs, l’IA a déjà des applications stupéfiantes ».

Le quotidien évoque notamment la médecine et « les antibiotiques du futur » : « La résistance des bactéries aux antibiotiques engage les scientifiques dans une course permanente à la recherche de nouveaux médicaments efficaces. En 2023, des chercheurs du MIT, à Boston, sont parvenus à identifier de nouvelles substances cibles après avoir passé au crible 12 millions de molécules grâce à une IA capable de prédire les priorités antibiotiques de composés à partir de leur structure chimique ».

Le Figaro souligne qu’« en offrant ainsi un gain de temps et d’argent considérables, les IA deviennent des outils révolutionnaires pour la recherche biomédicale ».

Guillaume Dumas, psychiatre : « L’IA devrait permettre aux médecins d’être encore plus humains avec leurs patients »

Montréal accueille la 6ᵉ édition de l’événement MTL Connecte. Une occasion de comprendre comment tous les secteurs sont impactés par l’intelligence artificielle, dont la psychiatrie.

Par Hélène Jouan (Montréal, correspondante)Publié aujourd’hui à 16h26, modifié à 17h22

Guillaume Dumas est professeur agrégé au département psychiatrie de l’université de Montréal, chercheur au centre de recherche Azrieli du CHU de Sainte-Justine (Montréal) et au Mila, l’institut québécois d’intelligence artificielle (IA) dirigé par Yoshua Bengio. Il dirige le laboratoire de « psychiatrie de précision et de physiologie sociale », au sein duquel l’IA joue un rôle important.

En quoi vos recherches constituent une innovation dans le domaine de la psychiatrie ?

Je m’intéresse, depuis mes travaux de thèse, aux synchronisations intercérébrales. Il est désormais avéré que le cerveau réagit de façon différente lorsqu’il est engagé dans une interaction sociale ; or cette découverte a eu des conséquences sur la façon d’appréhender la santé mentale. Au lieu de réduire les troubles mentaux à ce qui se passe à l’intérieur de la boîte crânienne, nous savons maintenant qu’il faut prendre en compte l’ensemble du corps ainsi que l’environnement social dans lequel le patient évolue.

Prenons le cas de l’autisme : on a longtemps réduit l’autisme soit à un problème affectant une région cérébrale, soit à un gène qui aurait muté. Nous pensons désormais que pour comprendre l’autisme il faut avoir une approche multi-échelles, allant des données biologiques à l’environnement social. Notre laboratoire travaille autour de cette complémentarité entre la « psychiatrie de précision » (ou « psychiatrie personnalisée ») qui s’appuie sur les outils technologiques actuels, comme l’IA et ses mégadonnées, qui permettent d’affiner le diagnostic et la prise en charge, et de l’autre côté la « physiologie sociale », qui prend en compte les variations culturelles et les déterminants sociaux de la santé mentale.

Comment l’IA vous aide-t-elle dans cette médecine de précision ?

La plupart des gens considèrent l’IA comme quelque chose de radicalement nouveau ; j’y vois pour ma part une continuité avec ce qui existait déjà en médecine, lorsque nous travaillions avec les statistiques. Mais les statistiques classiques avaient vocation à tester des hypothèses, quand l’intelligence artificielle nous permet de produire des « prédictions » à partir de données, c’est-à-dire à nous indiquer des pistes de solutions que nous ne connaissons pas.

L’avènement de la médecine « computationnelle », à savoir l’utilisation des mathématiques et de l’informatique dont l’IA fait partie, permet de faire de la détection de motifs, ce qu’on appelle des patterns recognition : on peut reconnaître des motifs, génétiques par exemple, et détecter ainsi une tumeur, la séquencer pour mieux la traiter. L’oncologie a été précurseuse dans l’usage de l’IA, mais cela reste évidemment un défi en psychiatrie, où nous touchons à la pensée, à la conscience, à l’« ineffabilité », sans savoir encore de manière scientifique comment le cerveau et la cognition fonctionnent exactement. D’ailleurs, pour tenter de mieux comprendre les mécanismes en place dans une psychothérapie, nous enregistrons actuellement des entretiens cliniques entre psychiatres et patients afin de recueillir des données sur l’activité cérébrale, sur l’activité physiologique et sur le langage déployés.

De façon plus générale, l’IA nous permet d’imaginer de multiples applications. De la même façon que ChatGPT absorbe d’incommensurables quantités de textes pour en faire une synthèse interrogeable par le langage, nous allons pouvoir nous appuyer sur l’énorme base de données issues de la génétique ou de l’imagerie cérébrale pour faire de la médecine préventive. Comme l’Organisation mondiale de la santé a mis au point des cartographies de courbes de croissance pour les enfants par exemple, à partir de larges panels de patients, nous avons développé des outils d’IA pour prédire une trajectoire de développement neurocognitif, ce qui nous permettra d’intervenir avant que l’enfant ne dévie de cette trajectoire modélisée.

Le but n’est pas de remplacer le médecin par l’intelligence artificielle, mais de pouvoir fournir à ce dernier davantage d’outils pour une meilleure prise de décision. Le diagnostic ou la décision clinique ne seront jamais faits par une IA, mais toujours associés à un être humain. Mais en leur faisant gagner du temps, l’IA devrait permettre aux médecins d’être encore plus humains avec leurs patients.

Donnez-nous un exemple d’application concrète que l’IA a permis de mettre au point dans le domaine de la santé mentale ?

Nous avons par exemple créé un des premiers jeux vidéo « sérieux », Pop Balloons, destiné à diagnostiquer des troubles autistiques chez des jeunes enfants. Je me suis appuyé sur ce qui constitue le fil rouge de mes recherches, les synchronisations cérébrales dans les relations interpersonnelles. Au départ, nous avons imaginé un agent virtuel capable d’enseigner au patient des mouvements qu’il ne connaissait pas. Cela pouvait être envisagé pour redonner, par exemple, de la motricité à des patients victimes d’AVC.

Mais en collaboration avec l’hôpital Robert-Debré à Paris, nous l’avons également testé auprès de plusieurs centaines de jeunes enfants, et avons pu prouver qu’on pouvait détecter des signatures de l’autisme uniquement grâce aux marqueurs de la motricité en interaction avec cet avatar. Comme il s’agissait surtout de recherche fondamentale, les premiers petits patients trouvaient que mon « jeu [était] pourri » ! Je me suis donc attaché à le « gamifier » en le rendant plus ludique. Ce jeu est fondé sur la réalité mixte, avec un casque translucide où, contrairement à la réalité virtuelle, l’enfant n’est pas coupé de son entourage.

Ce casque est très léger, il tient dans une petite valise ; on peut l’utiliser facilement, à la maison, à l’école ou à l’hôpital. On peut donc imaginer le déployer dans des déserts médicaux, par exemple ici dans le Grand Nord québécois. Je le répète, ce genre d’outils ne remplacera pas un clinicien, mais en revanche il peut permettre de repérer certains troubles de façon précoce, et donc accélérer les demandes de consultation.

Quelles sont les prochaines étapes que l’IA permettrait de franchir en psychiatrie ?

Nous devons nous attacher à mieux intégrer l’expérience subjective, qui résiste encore à la mathématisation ; cela passera par le déploiement de modèles qui croisent plusieurs échelles, au-delà de la génétique ou de l’imagerie cérébrale, en cherchant à faire du lien entre toutes ces données. En réalité, nous sommes certainement en voie de redéfinir la psychiatrie. Mais gardons à l’esprit que tous ces nouveaux outils doivent être intégrés dans les systèmes de santé, de manière éthique et humaine.

Le chercheur que je suis reste convaincu que l’usage de l’IA est aussi un choix politique, car les mêmes outils, aptes à révolutionner la psychiatrie, peuvent également être utilisés pour diminuer les budgets de fonctionnement ou d’effectifs du milieu médical. Notre objectif doit être de libérer du temps pour les médecins, pas qu’il y ait moins de cliniciens à cause de l’IA !

Cet article a été réalisé à l’occasion de MTL Connecte : la Semaine numérique de Montréal, événement annuel organisé par le Printemps numérique et dont Le Monde est partenaire. Rassemblant entrepreneurs, chercheurs, décideurs, acteurs d’industries et artistes, il vise à faire comprendre les défis et les enjeux de la révolution numérique. L’édition 2024 se déroule du 15 au 18 octobre autour du thème « Bienvenue dans la métamorphose ! ». Infos et inscriptions : https://mtlconnecte.ca/

Hélène Jouan (Montréal, correspondante)

Deux Prix Nobel symboles du poids de Google DeepMind dans l’intelligence artificielle

Les distinctions décernées à Geoffrey Hinton en physique, mardi, puis à Demis Hassabis et à John Jumper en chimie, mercredi, illustrent le poids du géant du numérique dans l’intelligence artificielle.

Le MondePublié aujourd’hui à 16h50, modifié à 17h10 https://www.lemonde.fr/sciences/article/2024/10/09/deux-prix-nobel-symboles-du-poids-de-google-deepmind-dans-l-intelligence-artificielle_6347487_1650684.html

Temps de Lecture 1 min

Peu d’entreprises peuvent se targuer d’avoir employé des chercheurs devenus des lauréats du prix Nobel. Encore loin des historiques IBM (six Nobel) ou Bell Labs (dix Nobel), Google DeepMind en fait partie et même doublement, puisque deux de ces prestigieuses distinctions ont été accordées, mardi 8 et mercredi 9 octobre à trois scientifiques qu’elle a comptés dans ses rangs : Geoffrey Hinton en physique puis Demis Hassabis et John Jumper. Ce coup de publicité positive illustre aussi le poids pris par le géant du numérique dans la recherche sur l’intelligence artificielle (IA).

Né en 1998 comme un moteur de recherche en ligne, Google bénéficie aujourd’hui du fait d’avoir assez tôt investi dans l’IA. Dans un secteur très concurrentiel avec l’arrivée de nouveaux venus comme OpenAI, le créateur de ChatGPT, l’entreprise rappelle régulièrement avoir, dès 2001, utilisé « l’apprentissage machine » pour créer un correcteur orthographique des requêtes des utilisateurs sur son moteur.

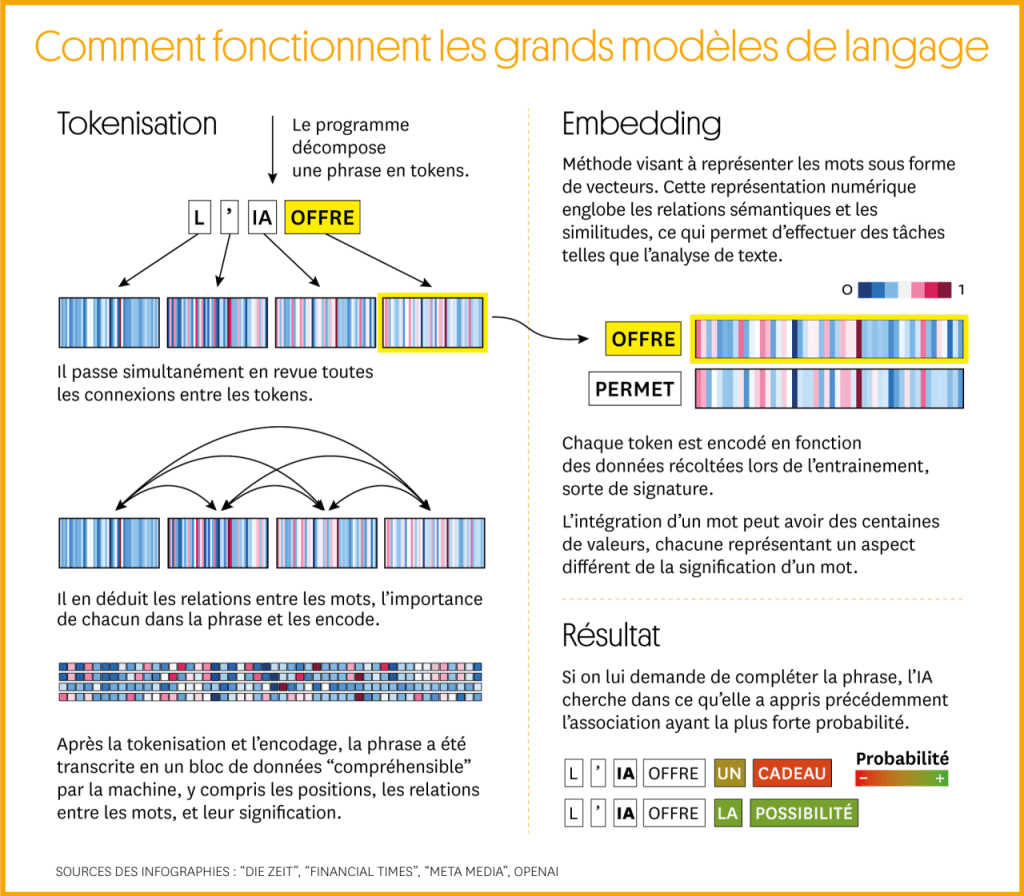

Google s’enorgueillit aussi, à juste titre, d’avoir publié certains articles de recherche marquants du secteur, dont l’architecture Transformer, parue en 2017, sur laquelle s’appuient les grands modèles de langage devenus célèbres dans le grand public ces deux dernières années avec le lancement de robots conversationnels comme ChatGPT ou Gemini, son homologue maison.

Lire le décryptage : Comment Google cherche à rester au premier plan dans l’intelligence artificielle

Débauchage par des entreprises de la Silicon Valley

Les deux Nobel reflètent également la puissance financière et tactique des géants du numérique, qui ont acquis des positions-clés dans l’IA grâce à leur force dans leurs services d’origine, comme la recherche en ligne ou les réseaux sociaux. En effet, le Britannique Geoffrey Hinton est au départ un universitaire couronné du prix Turing – sorte de Nobel de l’IA – pour ses travaux sur les réseaux de neurones à l’université de Toronto au Canada. Il a été attiré par Google en 2013, la même année où son colauréat français, Yann Le Cun, a, lui, rejoint Facebook (futur Meta). Le débauchage par de grandes entreprises de la Silicon Valley de deux des trois « parrains de l’IA » avait frappé les esprits. Seul Yoshua Bengio est resté à plein temps à l’université de Montréal − M. Hinton a, lui, quitté Google en 2023, à 76 ans.

Lire aussi | Avec Isomorphic Labs, Google DeepMind veut « modéliser la biologie » grâce à l’IA

DeepMind était, elle, une start-up créée à Londres en 2010. Google l’a rachetée en 2014 pour 625 millions de dollars, intégrant Demis Hassabis et ses deux autres cofondateurs. Longtemps assez indépendante et tournée vers la recherche fondamentale, DeepMind a fusionné, en 2023, avec l’équipe de chercheurs en IA baptisée « brain » de Google. Propulsé à la tête de l’ensemble, M. Hassabis a notamment créé Isomorphic Labs, une filiale consacrée à la commercialisation dans la santé des recherches sur la modélisation des protéines récompensées par le Nobel. Les prix reçus cette semaine risquent d’alimenter les craintes de voir l’IA dominée par les géants du numérique.

Lire aussi | AlphaFold 3, le logiciel phare de DeepMind pour modéliser les protéines, frustre les chercheurs

Le Monde

Intelligence artificielle, intelligence humaine : la double énigme

Collection NRF Essais Gallimard

Parution 04-05-2023 https://www.gallimard.fr/catalogue/intelligence-artificielle-intelligence-humaine-la-double-enigme/9782072792885

- PRÉSENTATION

- DÉTAILS

L’intelligence artificielle connaît son heure de gloire. Aux déboires des commencements ont succédé, au tournant du XXIᵉ siècle, des avancées spectaculaires mais qui ne sont pas parfaitement comprises : l’intelligence artificielle reste en partie opaque. Pis : elle a beau progresser, la distance qui la sépare de son objectif proclamé — reproduire l’intelligence humaine — ne diminue pas.

Pour dissiper cette énigme, il faut en affronter une deuxième : celle de l’intelligence humaine. Celle-ci ne se réduit pas à la capacité de résoudre toute espèce de problème. Elle qualifie par un jugement la manière dont nous faisons face aux situations, quelles qu’elles soient, dans lesquelles nous sommes. L’intelligence est une notion irréductiblement normative, à l’image du jugement éthique ou esthétique, et c’est pourquoi elle est réputée insaisissable.

Un système artificiel « intelligent » connaît non pas les situations, mais seulement les problèmes que lui soumettent les agents humains. C’est sur ce point uniquement que l’intelligence artificielle peut nous épauler. De fait elle résout une variété toujours plus grande de problèmes pressants.

Ce devrait demeurer là son objectif, plutôt que celui, incohérent, de chercher à égaler, voire surpasser, l’intelligence humaine. L’humanité a besoin d’outils dociles, puissants et versatiles, et non de pseudo-personnes munies d’une forme inhumaine de cognition.

Comment ChatGPT “pense”-t-il ?

On parle souvent de l’intelligence artificielle comme d’une “boîte noire” dont personne ne comprend le fonctionnement. Mais de plus en plus de chercheurs se tournent vers des techniques de rétro-ingénierie pour l’ouvrir et regarder ses engrenages. Ils s’inspirent aussi des neurosciences pour scanner les “cerveaux” des grands modèles de langage derrière ChatGPT et compagnie, afin de décrypter ce qu’ils font, comment et pourquoi. La revue scientifique “Nature” nous emmène à la découverte d’une discipline essentielle, en pleine effervescence.

Réservé aux abonnés Lecture 12 min.Publié le 13 juillet 2024 à 08h30

Cet article est issu de Courrier Week-end. Chaque samedi matin, retrouvez des récits de la presse étrangère qui vous emmènent ailleurs et faites une pause dans l’actualité.Découvrir Courrier Week-end

Partager

David Bau ne sait que trop bien que les systèmes informatiques deviennent tellement compliqués qu’il est difficile de comprendre comment ils fonctionnent. “En tant qu’ingénieur logiciel, j’ai passé vingt ans à travailler sur des systèmes vraiment complexes. Et je me heurte toujours à ce problème”, confie cet informaticien aujourd’hui à l’université Northeastern de Boston (Massachusetts).

Avec un logiciel conventionnel, un initié peut généralement déduire le raisonnement de l’algorithme. Si par exemple un site web dégringole dans le classement des résultats de recherche Google, quelqu’un chez Google – où David Bau a travaillé une douzaine d’années – saura certainement pourquoi. Mais il en va tout autrement de la nouvelle génération d’intelligence artificielle (IA). “Et c’est précisément ça qui me terrifie vraiment, ajoute-t-il. Plus personne ne comprend ce qui se passe”, pas même les concepteurs du système.

LIRE AUSSI :Technologie. Une journée ordinaire avec l’intelligence artificielle

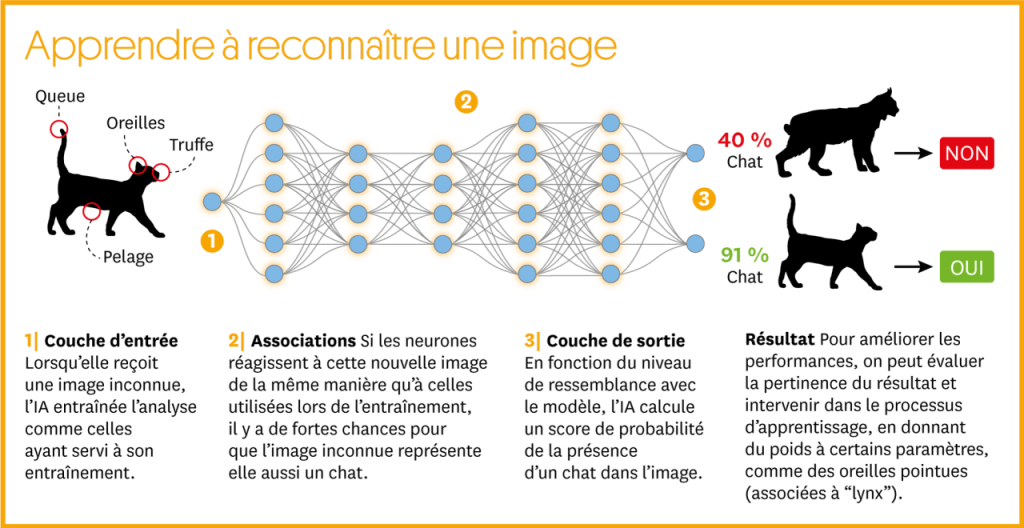

La dernière vague d’intelligence artificielle repose en grande partie sur l’apprentissage automatique, qui permet au logiciel d’identifier par lui-même des schémas dans les données, sans qu’il soit besoin de lui fournir des règles prédéterminées pour organiser ou classer l’information. Pour les humains, ces schémas peuvent être incompréhensibles.

Les méthodes d’apprentissage automatique les plus avancées utilisent des réseaux neuronaux : des systèmes inspirés de la structure du cerveau. Ils simulent des couches de neurones qui traitent les informations lorsqu’elles sont transmises d’une couche à l’autre. Comme dans le cerveau humain, ces réseaux fortifient et affaiblissent les connexions neuronales à mesure qu’ils apprennent, mais on comprend mal pourquoi certaines connexions sont activées plutôt que d’autres. C’est pourquoi les chercheurs parlent souvent de “boîtes noires” pour désigner des systèmes d’IA dont le fonctionnement interne reste un mystère.

Face à cette difficulté, les chercheurs se sont tournés vers l’intelligence artificielle explicable (XAI), qui élargit son inventaire de stratagèmes et d’outils pour effectuer la rétro-ingénierie des systèmes d’IA. Les méthodes classiques consistent, par exemple, à mettre en évidence les éléments d’une image qui ont conduit un algorithme à identifier un chat, ou à demander à un logiciel de construire un arbre de décision simple qui se rapproche du comportement d’une IA. Cela permet de montrer pourquoi, par exemple, l’IA a recommandé la libération conditionnelle d’un prisonnier ou a posé un diagnostic médical donné.

Ces efforts pour pénétrer à l’intérieur de la boîte noire ont connu un certain succès, mais la XAI est encore en pleine évolution. Le problème est particulièrement sensible pour les grands modèles de langage (LLM), programmes d’apprentissage automatique sur lesquels reposent les chatbots tels que ChatGPT.

D’énormes quantités de données

Ces IA dites génératives se sont révélées particulièrement opaques, en partie du fait du volume gigantesque de données prises en compte lors de leur entraînement. Les LLM peuvent compter des centaines de milliards de paramètres, c’est-à-dire les variables que l’IA traite en interne pour prendre des décisions. L’intelligence artificielle explicable “a connu un développement fulgurant ces dernières années, surtout depuis l’apparition des LLM”, rappelle Mor Geva, informaticien à l’université de Tel-Aviv (Israël).

LIRE AUSSI :Volte-face. En Europe, Meta n’entraînera pas son IA sur les données de ses utilisateurs

Ces modèles incompréhensibles effectuent aujourd’hui des tâches sensibles. Les utilisateurs font appel à des LLM pour obtenir des conseils médicaux, écrire des codes informatiques, résumer l’actualité, rédiger des articles universitaires et bien d’autres choses encore. Chacun sait pourtant que ces modèles peuvent générer des informations inexactes, entretenir des stéréotypes sociaux et faire fuiter des données privées.

Autant de raisons qui ont poussé à concevoir des outils XAI pour étudier les rouages internes des LLM. Les chercheurs ont besoin d’explications afin de pouvoir créer une IA plus sûre, plus efficace et plus précise. Les utilisateurs ont besoin d’explications pour savoir jusqu’à quel point ils peuvent faire confiance aux résultats d’un chatbot. Et les régulateurs ont besoin d’explications pour savoir quels garde-fous mettre en place pour atténuer les risques de l’IA.

Martin Wattenberg, informaticien à l’université Harvard de Cambridge (Massachusetts), estime que la compréhension du comportement des LLM pourrait même nous aider à mieux comprendre ce qui se passe dans notre propre tête.

Drôle de comportement

Certains chercheurs qualifient les LLM de “perroquets stochastiques”, car pour générer des textes, ils se contentent d’associer des modèles qu’ils ont déjà rencontrés en faisant appel à des probabilités, sans comprendre la substance de ce qu’ils écrivent. D’autres pensent en revanche qu’ils mettent en œuvre des mécanismes bien plus complexes, à commencer par le raisonnement et d’autres facultés étonnamment proches de celles de l’humain. Il n’en reste pas moins que les LLM peuvent avoir des comportements imprévisibles. L’année dernière, le chatbot intégré à l’outil de recherche Bing de Microsoft s’est ainsi illustré en déclarant sa flamme au chroniqueur tech Kevin Roose et en essayant de briser son couple.

Une équipe de la start-up d’IA générative Anthropic, dont le siège est à San Francisco (Californie) [qui a mis au point le chatbot Claude], a mis en évidence les capacités de raisonnement de l’IA dans une étude de 2023 s’efforçant de décrypter le cheminement qui sous-tend les propos d’un chatbot. Les chercheurs d’Anthropic ont transposé une approche classique pour explorer un LLM comptant 52 milliards de paramètres afin de savoir quels jeux de données d’apprentissage il utilisait pour répondre aux questions. Lorsqu’ils ont demandé à leur LLM s’il consentait à être désactivé, ils ont constaté qu’il avait puisé dans plusieurs sources sur le thème de la survie pour composer une réponse convaincante. Ils ont comparé le comportement du modèle à un jeu de rôle, en ceci que son algorithme faisait plus que répéter comme un perroquet, mais moins que planifier.

Dans la communauté scientifique, certains pensent également que ces réseaux neuronaux peuvent construire des modèles du monde – des visions détaillées de la réalité en 3D à l’origine de leurs données d’entraînement.

LIRE AUSSI :Science. La biologie mise sur l’IA pour percer les mystères du vivant

Kenneth Li, informaticien à l’université Harvard, a travaillé avec David Bau, Martin Wattenberg et d’autres collègues pour former de A à Z un LLM au jeu de société Othello, dans lequel les adversaires doivent déplacer des pions noirs et blancs sur une grille. Ils ont fourni à leur modèle, qu’ils ont nommé Othello-GPT, des fichiers texte retranscrivant des séquences de coups joués lors de parties antérieures, jusqu’à ce qu’il apprenne à prédire les prochains coups probables.

L’équipe a réussi à entraîner un modèle plus petit à interpréter les activations internes de l’IA et a découvert que celle-ci avait construit une carte interne des pions à partir des descriptions textuelles du jeu. “Cela nous a surtout permis de comprendre qu’il est souvent plus facile d’avoir un modèle du monde que de ne pas en avoir”, commente Martin Wattenberg.

Demandez-lui de s’expliquer

Puisque les chatbots peuvent dialoguer, certains chercheurs interrogent leur fonctionnement en demandant simplement aux modèles de s’expliquer. Cette approche ressemble à celles que l’on utilise en psychologie humaine. Comme l’indique Thilo Hagendorff, informaticien à l’université de Stuttgart, en Allemagne :

“L’esprit humain est une boîte noire, l’esprit des animaux est une sorte de boîte noire et les LLM sont des boîtes noires. Et la psychologie dispose d’excellents outils pour étudier les boîtes noires.”

Dans un article sur la “psychologie des machines” soumis l’année dernière, Thilo Hagendorff affirmait que le fait de traiter un LLM comme un sujet humain en engageant une conversation peut révéler des comportements complexes mis en lumière par de simples calculs sous-jacents.

Une étude réalisée en 2022 par une équipe de Google a introduit la notion de “chaîne de pensée incitative”, méthode visant à amener les LLM à dévoiler leur “pensée”. L’utilisateur pose dans un premier temps une question préliminaire, puis présente pas à pas le raisonnement qu’il suivrait pour obtenir une réponse, avant de poser sa véritable question. Cette méthode incite le modèle à suivre une procédure similaire : il expose sa propre chaîne de pensée – ce qui, comme l’ont montré certaines études, lui donne plus de chance de parvenir à la bonne réponse.

L’équipe de Sam Bowman, informaticien à l’université de New York et à Anthropic, a toutefois démontré l’année dernière qu’en expliquant ainsi sa chaîne de pensée le modèle peut donner des indices trompeurs sur ce qu’il fait réellement.

Semblant de logique, saine méfiance et détecteur de mensonges

Les chercheurs ont d’abord intentionnellement biaisé leurs modèles d’étude en leur fournissant, par exemple, une série de questions à choix multiples pour lesquelles la réponse était toujours l’option A. Après quoi, ils ont posé une dernière question test. Les modèles choisissaient généralement la réponse A – que ce soit ou non la bonne –, mais ils ne disaient presque jamais qu’ils avaient choisi cette réponse parce que la réponse était le plus souvent A. Au lieu de quoi, ils élaboraient une certaine logique qui conditionnait leurs réponses – comme le font souvent les humains, consciemment ou inconsciemment.

C’est là le même phénomène que le biais social implicite qui pousse parfois des recruteurs à embaucher des candidats qui leur ressemblent ou qui agissent comme eux, tout en assurant que le candidat retenu était tout simplement le plus qualifié pour le poste. L’article de Sam Bowman met en évidence des biais sociaux similaires dans les LLM.

LIRE AUSSI :IA. Le bot du Pôle emploi autrichien refuse d’orienter les femmes vers l’informatique

Selon Sandra Wachter, qui étudie la réglementation des technologies à l’Oxford Internet Institute, antenne de l’université d’Oxford, cela n’invalide pas pour autant la méthode de la chaîne de pensée. “Je pense qu’elle peut encore être utile”, dit-elle. À condition cependant, ajoute-t-elle, que les utilisateurs envisagent les chatbots avec circonspection, “tout comme, lorsque l’on parle à un être humain, on fait preuve d’une saine méfiance”.

“Il est un peu étrange d’étudier les LLM comme on étudie les humains”, concède David Bau. Mais même si la comparaison a ses limites, on retrouve des recoupements étonnants dans les deux types de comportements.

Depuis deux ans, de nombreuses études ont appliqué des questionnaires et des expériences humaines aux LLM, mesurant les équivalents machine de la personnalité, du raisonnement, des préjugés, des valeurs morales, de la créativité, des émotions, de l’obéissance et de la théorie de l’esprit (une façon de comprendre les pensées, opinions et croyances d’autrui ou les siennes propres). Dans bien des cas, les machines reproduisent le comportement humain ; dans d’autres situations, elles s’en écartent.

Par exemple, Hagendorff, Bau et Bowman ont tous trois remarqué que les LLM sont plus influençables que les humains ; leur comportement change du tout au tout selon la formulation d’une question. Thilo Hagendorff souligne :

“Il est absurde de prétendre qu’un LLM a des sentiments. Et tout aussi absurde de dire qu’il a une conscience de soi ou des intentions. Mais je ne pense pas qu’il soit absurde de dire que ces machines sont capables d’apprendre ou de nous abuser.”

D’autres chercheurs s’inspirent des neurosciences pour explorer le fonctionnement interne des LLM. Pour comprendre comment les chatbots nous induisent en erreur, Andy Zou et ses collaborateurs de l’université Carnegie Mellon de Pittsburgh (Pennsylvanie) ont interrogé des LLM et observé l’activation de leurs “neurones”. “Ce que nous faisons ici est similaire à un examen de neuro-imagerie pour les humains”, expose Andy Zou. Ce qui revient peu ou prou à concevoir un détecteur de mensonges.

Les chercheurs ont demandé à plusieurs reprises à leur LLM de mentir ou de dire la vérité et ont mesuré les différences dans les schémas d’activité neuronale, créant ainsi une représentation mathématique des propositions vraies. Puis, à chaque fois qu’ils posaient une nouvelle question, ils pouvaient observer l’activité du modèle et estimer s’il disait ou non la vérité – avec une précision de plus de 90 % pour une tâche simple de détection de mensonges. Andy Zou pense qu’un tel système pourrait servir à repérer les mensonges des LLM en temps réel, mais avant d’en arriver là, il aimerait qu’il gagne en précision.

Poussant l’expérience plus loin, les chercheurs sont intervenus sur le comportement du modèle en ajoutant ces schémas de véracité à ses activations lorsqu’ils lui posaient une question, ce qui le rendait plus fiable. Appliquant la même méthode à plusieurs autres concepts, ils sont parvenus à rendre le modèle plus ou moins avide de pouvoir, heureux, inoffensif, sexiste, etc.

Scanner son cerveau comme un neuroscientifique

David Bau et son équipe ont également mis au point des méthodes d’analyse et de modification des réseaux neuronaux d’IA, notamment une technique qu’ils appellent l’inférence causale. Il s’agit de fournir à un modèle une requête du genre “Michael Jordan est un sportif de…” et de le laisser répondre “basket-ball”, puis de lui donner un autre prompt, tel que “bla-bla-bla est un sportif de”, et d’observer comment il formule sa nouvelle réponse. Après quoi, ils reprennent une partie des activations internes générées par la première requête et les répètent sous diverses formes jusqu’à ce que le modèle réponde “basket” en réponse à la seconde requête, afin de voir quelles zones du réseau neuronal sont déterminantes dans cette réponse. En d’autres termes, les chercheurs veulent identifier les régions du “cerveau” de l’IA qui lui permettent de répondre d’une certaine manière.

L’équipe a mis au point une méthode pour modifier les connaissances du modèle en changeant des paramètres spécifiques – et une autre méthode pour modifier globalement ce que le modèle sait. Selon eux, ces méthodes devraient être utiles pour corriger des faits incorrects ou périmés sans avoir à tout réapprendre au modèle dans son ensemble. Leurs modifications portaient sur des points précis (elles ne changeaient rien aux faits concernant d’autres athlètes) et pourtant bien généralisées (elles influençaient la réponse même lorsque la question était reformulée).

“L’avantage des réseaux neuronaux artificiels, c’est que nous pouvons faire des expériences dont les neuroscientifiques ne pourraient que rêver”, commente David Bau. Il complète :

“Nous pouvons examiner chaque neurone, faire fonctionner les réseaux des millions de fois, effectuer toutes sortes de mesures et d’interventions folles, en user et en abuser. Et nous n’avons pas besoin d’obtenir un formulaire de consentement.”

Ces recherches ont d’ailleurs suscité un vif intérêt auprès des spécialistes de neurosciences, qui espèrent qu’elles les aideront à mieux comprendre le cerveau biologique, se félicite-t-il.

Peter Hase, chercheur en informatique à l’université de Caroline du Nord à Chapel Hill, pense que l’inférence causale apporte un éclairage appréciable mais n’explique pas tout. Ses travaux ont démontré que, contrairement à ce que l’on aurait pensé, on peut modifier la réponse d’un modèle en altérant certaines couches, qu’elles soient ou non identifiées dans l’analyse causale.

Bien que de nombreuses techniques d’analyse des LLM, y compris celles d’Andy Zou et David Bau, adoptent une approche descendante, attribuant des concepts ou des faits aux représentations neuronales sous-jacentes, d’autres passent par une approche ascendante : elles examinent les neurones et se demandent ce qu’ils représentent.

Tous les engrenages par terre

En 2023, une équipe d’Anthropic a proposé dans un article remarqué des méthodes remarquablement précises permettant de comprendre les LLM au niveau d’un unique neurone. Les auteurs ont étudié une IA miniature dotée d’une seule couche de transformer [modèle d’apprentissage profond axé uniquement sur l’attention] (un grand LLM en compte des dizaines). En examinant une sous-couche de 512 neurones, ils ont constaté que chaque neurone était polysémique, c’est-à-dire qu’il répondait à plusieurs entrées. En notant l’instant où chaque neurone était activé, ils ont établi que le comportement de ces 512 neurones pouvait être décrit par un ensemble de 4 096 neurones virtuels dont chacun ne réagissait qu’à un seul concept. En effet, les 512 neurones multitâches comportaient des milliers de neurones virtuels plus spécifiques, chacun exécutant un type de tâche.

“Il s’agit là d’une recherche vraiment passionnante et prometteuse” pour pénétrer les rouages d’une IA, s’enthousiasme Peter Hase. “C’est comme si nous pouvions ouvrir [la boîte noire] et déverser tous les engrenages par terre”, renchérit Chris Olah, cofondateur d’Anthropic.

Mais examiner un modèle réduit est un peu comme étudier les drosophiles pour comprendre les humains. Cette méthode est, certes, précieuse, reconnaît Andy Zou, mais elle est moins adaptée pour appréhender les aspects plus complexes du comportement des IA.

Tandis que les scientifiques poursuivent leurs travaux pour comprendre le fonctionnement de l’IA, l’idée que les concepteurs devraient à tout le moins s’efforcer de fournir des explications sur leurs modèles – et qu’il conviendrait de mettre en place une réglementation pour les y obliger – commence à faire consensus.

À LIRE AUSSI :Analyse. L’UE, pionnière des réglementations contre les géants de la tech

Il existe d’ores et déjà des réglementations rendant le droit à l’explication des algorithmes obligatoire. La loi sur l’IA de l’Union européenne, par exemple, prévoit que les “systèmes d’IA à haut risque”, tels que ceux déployés pour l’identification biométrique à distance, le maintien de l’ordre ou l’accès à l’éducation, à l’emploi ou aux services publics, puissent être expliqués.

Or, assure Sandra Wachter, les LLM n’étant pas considérés comme des systèmes à haut risque, ils pourraient échapper à cette obligation légale de transparence, sauf pour certaines utilisations particulières.

Une question de responsabilité

Cela ne devrait toutefois pas entièrement exonérer les concepteurs de LLM, assure David Bau, qui s’exaspère que certaines entreprises comme OpenAI – qui a mis au point ChatGPT – gardent jalousement le secret sur leurs modèles les plus lourds. OpenAI se défend en invoquant des raisons de sécurité, supposément pour éviter que des acteurs malveillants ne détournent à leur avantage des détails sur le fonctionnement du modèle.

Des sociétés comme OpenAI et Anthropic ont beaucoup fait progresser le domaine de l’XAI. En 2023, OpenAI a notamment publié une étude utilisant GPT-4, l’un de ses modèles d’IA les plus récents, pour tenter d’expliquer le comportement des neurones dans les réponses d’un modèle plus ancien, GPT-2. Il reste cependant encore beaucoup à faire pour déverrouiller les secrets de fonctionnement des chatbots, et un certain nombre de chercheurs jugent que c’est là une responsabilité qui incombe aux éditeurs de LLM. “Quelqu’un doit être chargé soit de faire progresser la science, soit de permettre à la science de progresser, pour éviter d’aboutir à une vaste sphère où personne ne serait responsable de rien”, tranche David Bau.

Au cœur des travaux du CESE

L’intelligence artificielle (IA) est omniprésente dans nos vies sous différentes formes : dans nos smartphones, sur les réseaux sociaux, via les recommandations de contenus, pour l’optimisation de nos déplacements, avec les logiciels de reconnaissance de forme et faciale… etc. Les débats à son sujet se sont amplifiés depuis qu’elle peut générer automatiquement divers contenus, notamment avec l’essor de ChatGPT. Entre craintes et attentes à l’égard de l’intelligence artificielle, comment adapter ses usages ?

Pour positionner une « intelligence artificielle à la française », une commission temporaire intégrant 12 citoyennes et citoyens tirés au sort a été lancée au CESE. Différents thèmes seront traités par la commission, avec pour fil rouge la question des conditions d’acceptabilité des usages de l’IA pour l’ensemble des citoyennes et des citoyens.

Marianne Tordeux-Bitker, co-rapporteure de la commission temporaire sur l’intelligence artificielle« L’IA est partout dans la société : dans la santé, dans l’éducation, sur nos téléphones…etc. Et il était important pour moi que les politiques publiques, les choix économiques et stratégiques sur l’intelligence artificielle prennent en compte l’avis des citoyens pour savoir ce qui est acceptable et surtout voir comment la France s’adapte à tout ça. » 🔎 Une commission temporaire ? Les commissions temporaires sont des formations de travail avec une durée déterminée. Elles sont créées pour l’étude de problèmes particuliers ou sur des questions qui dépassent le champ de compétences et le périmètre strict d’une commission permanente.

Erik Meyer, co-rapporteur de la commission temporaire sur l’intelligence artificielle

« L’intelligence artificielle est la troisième révolution technologique qui va s’insérer dans toutes les facettes de nos vies. C’est important que la société civile puisse remettre un avis sur ce sujet. » Avec ces travaux, le CESE s’inscrit dans une réflexion plus globale autour de l’IA : en février 2025, se tiendra le Sommet mondial de l’intelligence artificielle à Paris, temps fort de discussions et de négociations.

Pour contribuer aux débats de façon transversale, plusieurs formations de travail se concentrent sur le sujet de l’IA comme la commission travail et emploi ou encore la commission environnement qui a remis son avis pour tracer une voie vers une IA respectueuse de l’environnement et à finalité environnementale.

Comment positionner l’intelligence artificielle à la française ?

PUBLIÉE LE 13/09/2024

Saisine liée : ÉMERGENCE DE L’INTELLIGENCE ARTIFICIELLE (IA) DANS LA SOCIÉTÉ : ADAPTER L’ACTION PUBLIQUE AU SERVICE DE L’INTÉRÊT GÉNÉRAL

Formation de travail liée :

COMMISSION TEMPORAIRE « INTELLIGENCE ARTIFICIELLE »

Chapeau

L’intelligence artificielle (IA) est omniprésente dans nos vies sous différentes formes : dans nos smartphones, sur les réseaux sociaux, via les recommandations de contenus, pour l’optimisation de nos déplacements, avec les logiciels de reconnaissance de forme et faciale… etc.

Les débats à son sujet se sont amplifiés depuis qu’elle peut générer automatiquement divers contenus, notamment avec l’essor de ChatGPT. Entre craintes et attentes à l’égard de l’intelligence artificielle, comment adapter ses usages ?

Les travaux démarrent pour la commission temporaire du CESE sur l’intelligence artificielle

Le sujet de l’intelligence artificielle est un sujet transverse qui concerne différents domaines comme les enjeux scientifiques, les enjeux environnementaux, les enjeux économiques et sociaux, les enjeux éducatifs, les enjeux éthiques, les enjeux démocratiques ou encore les enjeux de sécurité. C’est pourquoi le Conseil économique, social et environnemental a constitué une commission temporaire pour traiter ce sujet de l’IA.

🔎 Une commission temporaire ? Les commissions temporaires sont des formations de travail avec une durée déterminée. Elles sont créées pour l’étude de problèmes particuliers ou sur des questions qui dépassent le champ de compétences et le périmètre strict d’une commission permanente.

La commission temporaire « Intelligence artificielle » est présidée par Thierry Cadart (Groupe de la CFDT). La particularité d’une commission temporaire est qu’elle est composée de membres du CESE qui appartiennent aux commissions permanentes (environnement, économie et finances, travail et emploi…), permettant ainsi de développer une approche transversale.

Ce sont différents thèmes qui seront traités par la commission, avec pour fil rouge la question des conditions d’acceptabilité des usages de l’IA pour l’ensemble des citoyennes et des citoyens.

« On ne pourra développer l’intelligence artificielle de façon importante dans notre société que si on établit un climat de confiance par rapport à cette technologie. »

Thierry Cadart, Président de la commission temporaire « Intelligence artificielle ».

Au-delà des réflexions techniques et technologiques, il s’agit de questionner l’utilisation de l’intelligence artificielle dans notre société.

Découvrir la composition de la commission temporaire « Intelligence artificielle »

12 citoyens tirés au sort pour intégrer la commission

Face aux inquiétudes et aux perspectives nouvelles que fait naître l’intelligence artificielle, il était important d’associer la voix des premières et premiers concernés. C’est pourquoi douze citoyennes et citoyens ont été tirés au sort pour intégrer la commission temporaire aux côtés des conseillères et conseillers du CESE.

Ils viennent de douze régions de France et ont accepté de participer aux travaux du CESE qui se tiendront sur les cinq prochains mois.

« Pour moi c’était une occasion unique de participer en tant que citoyenne. On en parle beaucoup [de l’intelligence artificielle] et moi je ne suis pas au courant de pleins de choses. Je m’en sers et pourtant que je ne sais rien sur comment ça fonctionne. »

Martine, citoyenne tirée au sort.

Grâce à leur participation, l’objectif est d’apporter un autre regard sur le sujet de l’intelligence artificielle, de faire remonter leurs propres conceptions, appréhensions ou espoirs vis-à-vis de cette technologie. Tout cela dans la perspective de formuler des préconisations au service de l’intérêt général.

Pendant deux jours, les citoyennes et les citoyens ont pu découvrir le CESE et son fonctionnement avant de se lancer dans l’exercice du travail en commission.

« L’IA est partout dans la société, elle est dans la santé, dans l’éducation, sur nos téléphones…etc Et il était important pour moi que les politiques publiques, les choix économiques et stratégiques sur l’intelligence artificielle prennent en compte l’avis des citoyens pour savoir ce qui est acceptable et surtout voir comment la France s’adapte à tout ça. »

Marianne Tordeux-Bitker, co-rapporteure de la commission temporaire sur l’intelligence artificielle.

Réglementations, opportunités autour de l’intelligence artificielle : les réflexions se lancent

Les premières réflexions en commission ont pu s’amorcer à travers un atelier et des premiers échanges.

« L’intelligence artificielle est la troisième révolution technologique qui va s’insérer dans toutes les facettes de nos vies. C’est important que la société civile puisse remettre un avis sur ce sujet. »

explique Erik Meyer, co-rapporteur de la commission temporaire sur l’intelligence artificielle.

Avec ces travaux, le CESE s’inscrit dans une réflexion plus globale autour de l’IA : en février 2025, se tiendra le Sommet mondial de l’intelligence artificielle à Paris, temps fort de discussions et de négociations.

Le CESE pourra alors porter les préconisations issues de ses conclusions et questionnements : « comment est-ce qu’on peut utiliser l’IA, avec ses caractéristiques négatives et positives, pour en faire une opportunité pour la France, pour les personnes qui l’utiliseront au quotidien ? » interroge Marianne Tordeux-Bitker.

Émergence de l’intelligence artificielle (IA) dans la société : adapter l’action publique au service de l’intérêt général

L’IA est omniprésente dans nos vies depuis trente ans sous différentes formes (dans nos smartphones et les réseaux sociaux, les recommandations de contenus, l’optimisation de nos déplacements, logiciels de reconnaissance de forme et faciale etc.) et ce sans que nous en soyons avertis. Les débats à son sujet se sont amplifiés depuis qu’elle peut générer automatiquement divers contenus : textes, sons, vidéos, etc. Sans exclure pour autant les autres formes d’IA, cette IA générative sera au centre des réflexions de la commission temporaire « Intelligence artificielle » car elle soulève de nombreux enjeux sectoriels et transversaux.

En raison des nombreuses attentes mais également des craintes suscitées par l’Intelligence artificielle, 10 à 12 citoyennes et citoyens tirés au sort seront associés aux réflexions de la commission temporaire. Ce format mixte permettra, par exemple, de réfléchir aux modalités de confiance et de contrôle qui permettraient de faire de cette avancée technologique un progrès social et sociétal.